实时引擎驱动的大数据高效整合架构

|

在当今数字化浪潮中,数据已成为企业决策与创新的核心驱动力。然而,随着物联网、社交媒体、移动设备等多元渠道的爆发式增长,数据量呈指数级攀升,且类型复杂多样,传统批处理模式已难以满足实时性需求。实时引擎驱动的大数据高效整合架构应运而生,其核心目标是通过技术融合实现数据从采集到分析的全链路低延迟处理,让企业能够快速捕捉市场变化、优化运营效率并提升用户体验。 实时引擎的构建依赖于流处理技术与分布式计算框架的深度整合。传统批处理需等待数据积累至一定规模后统一处理,而流处理技术(如Apache Flink、Kafka Streams)则通过“事件驱动”模式,将数据视为连续流动的“事件流”,实现逐条或微批次处理。例如,电商平台中用户点击、加购、下单等行为可实时转化为事件流,引擎通过窗口聚合、状态管理等机制,在毫秒级内完成用户行为分析,为个性化推荐提供动态依据。分布式计算框架(如Spark Streaming)通过内存计算与并行处理能力,进一步突破单机性能瓶颈,确保高吞吐场景下的低延迟响应。 数据高效整合的关键在于打破“数据孤岛”,构建统一的数据管道。实时引擎需支持多源异构数据的接入,包括结构化数据库、非结构化日志、时序数据(如传感器读数)等。通过标准化协议(如MQTT、HTTP)与解析工具(如Logstash、Fluentd),引擎可将原始数据转换为统一格式,并存入分布式存储系统(如HDFS、S3)或内存数据库(如Redis、Memcached)。例如,智能工厂中,设备传感器数据、生产日志、质量检测报告等通过实时引擎整合后,可形成完整的生产链路视图,帮助管理者实时监控设备状态、预测故障并优化排产。 低延迟与高可靠性的平衡是架构设计的核心挑战。实时引擎需采用多层级容错机制保障数据完整性:在数据采集层,通过消息队列(如Kafka)的持久化存储与多副本策略,防止数据丢失;在处理层,通过检查点(Checkpoint)与状态快照技术,实现故障恢复时的状态回滚;在存储层,通过分布式文件系统的冗余设计与冷热数据分层存储,兼顾性能与成本。例如,金融风控场景中,交易数据需在毫秒级内完成反欺诈检测,引擎通过并行处理与状态同步机制,确保每笔交易均经过完整规则校验,同时避免因单点故障导致业务中断。

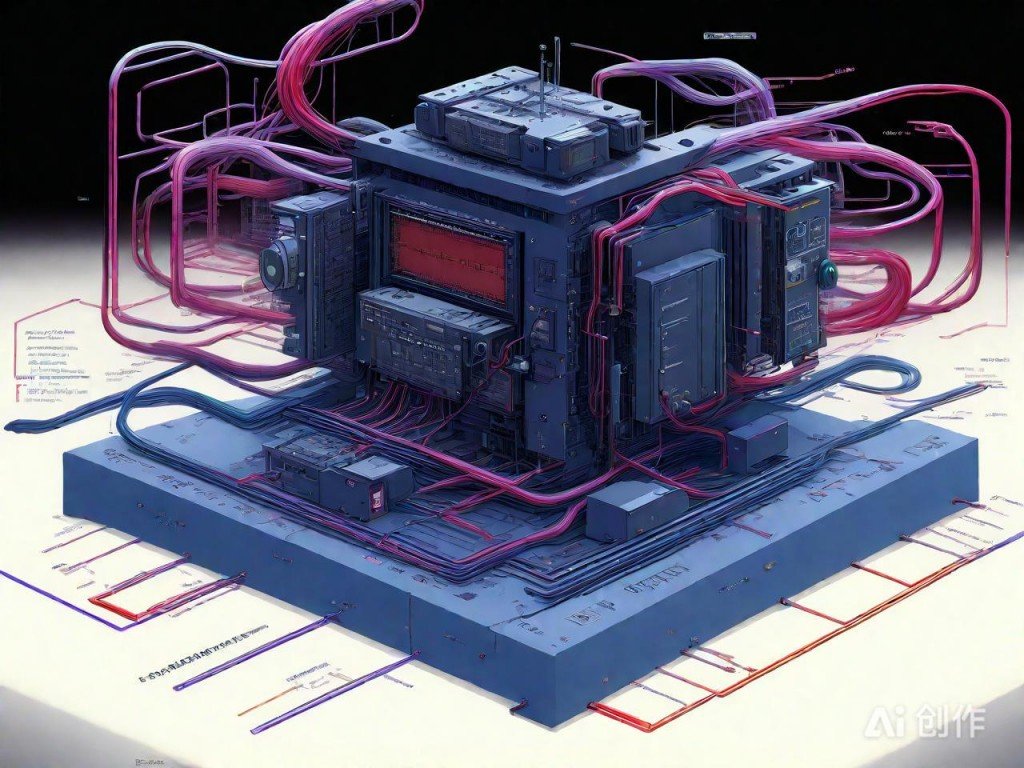

2026AI生成图像,仅供参考 实时引擎的价值最终体现在业务场景的落地。在智慧城市中,交通流量数据、气象信息、公共事件等通过实时整合后,可驱动智能交通信号控制、灾害预警等应用;在医疗领域,患者生命体征、电子病历、设备数据等实时分析可支持远程监护与急救决策。这些场景的共同点在于:数据时效性直接决定业务价值。例如,零售企业通过实时分析门店客流与销售数据,可动态调整库存与促销策略,将滞销品转化率提升30%以上;能源企业通过实时监控电网负载,可优化发电调度,降低10%以上的运营成本。展望未来,实时引擎将与人工智能、边缘计算等技术深度融合。AI模型可嵌入实时处理流程,实现动态预测与自适应优化;边缘计算将部分处理能力下沉至设备端,进一步降低延迟。例如,自动驾驶汽车需通过车载实时引擎处理摄像头、雷达等传感器数据,结合AI决策模型实现毫秒级避障;工业互联网中,边缘节点可实时分析设备振动数据,提前预警故障并触发维护工单。随着5G、物联网等基础设施的完善,实时引擎驱动的大数据整合架构将成为企业数字化转型的“基础设施”,助力其在瞬息万变的市场中占据先机。 (编辑:91站长网) 【声明】本站内容均来自网络,其相关言论仅代表作者个人观点,不代表本站立场。若无意侵犯到您的权利,请及时与联系站长删除相关内容! |